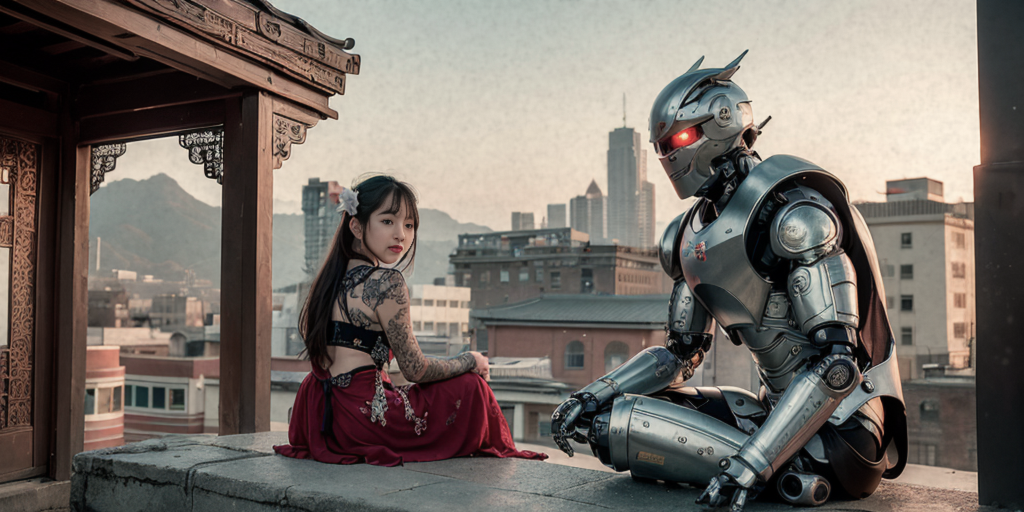

人工智能会有意识吗?

这是一个在当下极具流量的话题。如果我宣称“奇点临近,AI 即将觉醒”,或许更能博取眼球。但在冷静审视后,我依然坚持一个可能略显扫兴的观点:目前的人工智能与真正的“意识”之间,横亘着一道难以逾越的天堑。我们这一代人,恐怕很难见到真正具备自我意识的机器。

但在论证这个观点之前,我们需要先剥离掉科幻电影的滤镜,看看 AI 的骨子里到底是什么。

AI 的前世今生

人工智能并不是什么新鲜事,它的概念最早可追溯到八十年前。这期间,AI 经历过数次从“捧上神坛”到“跌落谷底”的循环。每次技术突破都会让人们对 AI 的未来充满期待,同时也伴随着担忧,比如 AI 是否会威胁人类的工作岗位或控制权。然而,每次热潮过后,技术的局限性又让热情逐渐冷却,直到下一次突破带来新一轮的关注。

虽然我对人工智能的兴趣由来已久,但真正开始系统学习是在 2012 年左右。当时,"人工智能"这个词已经不再是热门话题,取而代之的是“机器学习”(ML)。严格来说,机器学习是人工智能的一种实现方法。但 AI 这个单词收到的冷遇,这多少反映了当时 AI 正处于冷静期:上一波热潮退去,学者们正试图使用一些更性感的词条��来引起大众兴趣。

机器学习包含多种算法,比如朴素贝叶斯、决策树等。这些名字可能听起来陌生,但多数人应该会听说过其中的一种关键技术:神经网络。在我开始学习 AI 的时候,神经网络正处于低谷,并不受主流认可。虽然它的概念提出已有几十年历史,但当时在许多应用领域的表现并不突出,比如在图像识别中不如支持向量机,在自然语言处理中也逊色于隐马尔可夫模型。因此,很多人认为神经网络前景有限。

然而,技术的进步改变了一切。近年来,神经网络以惊人的速度崛起,成为 AI 的核心技术。如今,几乎所有引人瞩目的 AI 项目都依赖神经网络,因此有必要简要介绍其工作原理。接下来,本文提到的 AI 默认指代基于神经网络的模型。

AI 的本质只是“函数”

要理解 AI 为什么没有意识,首先要明白它在做什么。

抛开那些玄乎的名词,神经网络本质上是一个解决复杂问题的数学工具。我们可以把一切问题抽象为“函数”:输入 输出 。比如:

- 一个用来计算乘法的函数,它的输入是两个数,输出是它们的乘积;

- 一个聊天生成的函数,输入是一些文字,输出是相应的回复;

- 一个绘图的函数,输入是一些文字,输出是一幅图像。

对于简单的问题,比如乘法函数,我们可以直接使用已有的高效算法来解决,不需要神经网络。

神经网络主要应用于那些特别复杂的问题,比如“画一只猫”这种复杂问题,人们没办法直接为这类函数提炼出一个简单直观的数学公式。但问题还是可以解决:如果读者听说过“级数”这个概念,可能已经知道了,任何一个函数,都可以被看作是很多很多其它函数的叠加;如果没听说过也不要紧,只要记住这个结论就可以了:如果遇到一个极其复杂的函数,我们可以把它拆解成许许多多简单的小函数,再让这些小函数的结果叠加在一起,恰好可以实现复杂函数的功能。

神经网络就是利用这个原理,通过无数个类似 的简单节点层层叠加,去拟合那个复杂的、未知的目标函数。假设我们有一个复杂的函数,它的输入是 X,输出是 Y,可以将其表示为多个简单函数的叠加:

Y = (w0*X + b0) + (w1*X + b1) + (w2*X + b2) + ... + (wn*X + bn)

其中每个 (w*X + b) 的部分就是神经网络中的一个节点。而 w0 ~ wn 和 b0 ~ bn 则是神经网络中的参数。这些参数的值不是人为设定的,而是通过神经网络的训练过程去找到的。实际应用中的神经网络会比上述例子更加复杂,比如每个节点的函数会是更复杂一点的非线性函数,会有更多的层次等,但原理依然相同。

为了找到最适合的参数值,首先需要为模型构建一个训练集,例如,对于生成图片的模型,每个训练条目包含两部分:输入的文字和输出的图片。模型首先使用输入的文字作为输入,使用当前的参数生成一张图片,然后将其与目标图片进行比较,提取差异。根据差异的大小,调整网络中的每个参数,使其产生更接近目标图片的结果。不断重复这一过程,直到模型产生的图片与目标图片相似��为止。

这一过程被称为“训练”,可以看作是模型模拟数据集或拟合目标函数的过程。通过不断优化,神经网络能够从数据中学习到复杂问题的解决方法。

AI 的行为是否连其设计者都不能理解?

当我训练好一个神经网络之后,我是否能够知道网络中每个参数的值呢?是的,这些数据都在硬盘里。

但这里确实存在一个微妙的“不可解释性”。虽然我们设计了网络的结构(比如有多少层,怎么连接),也掌握了所有的参数数字,但当参数量达到数百亿甚至万亿级别时,我们很难具体解释某一个具体的参数在决策中到底起了什么作用。这就像我们了解人类大脑的解剖结构,却很难看着显微镜下的神经元说“这个神经元代表了对苹果的喜爱”。

所谓的“AI 失控论”往往夸大了这一点。作为设计者,我们虽然无法追踪每一个微小的神经元活动,但我们掌握着**“损失函数”(Loss Function)**——也就是指挥棒。我们通过数学手段严格限制了 AI 的整体学习方向。只要它偏离了目标(比如胡说八道),训练算法就会惩罚它。

因此,准确的说法是:我们在微观上可能无法完全解释 AI 的每一步推理路径(黑盒特性),但在宏观上,它的行为逻辑完全处于数学规则和设计目标的约束之下。

但这一点造成了很多人对于神经网络的一个误解,他们会说:原来你都不知道神经网络里具体的数据啊,肯定更不知道每个参数的含义啦,你自己设计的神经网络你自己都理解不了,看来人工智能要摆脱人类控制了。

这种说法类似于对一个火箭设计者说:你连每个燃料分子燃烧的位置都不知道,你怎么能理解你设计的火箭呢?但实际上,设计火箭并不需要了解每个分子的情况,只要知道所有燃料作为一个整体能否提供足够的动力就可以了。同样的,神经网络的设计者也不需要,更不应该去纠结网络中每个参数的值,设计者应该去了解的是当所有参数作为一个整体时,能否拟合目标函数。

现在读者应该可以看出来了,所谓 AI 设计者不了解自己设计的 AI,纯粹是一种误解。其实,只要换位思考一下就知道这种误解的不合逻辑之处:读者自己是否理解 AI 的工作原理?如果理解不那么深刻,那么你能够设计出一个 AI 模型吗?如果你因为不完全了解 AI 而无法设计一个 AI 模型,又怎么能相信别人会在不了解 AI 的情况下就设计出了一个好用的 AI 模型呢?

AI 有没有创造力?

AI 是否能表现出超出设计的行为?它的创造力如何?

这要看你如何定义创造力了。一个 AI 在学习了猫头,狗身的照片之后,可以画出一张猫头狗身拼接在一起的照片。如果你觉得这算是创造力,那么AI确实具有了一定的创造力。

如果你觉得不算,只有 AI 画出了训练集中没有的某种新生物才算创造,比如训练集中只有猫和狗,但模型却能画出一匹马。如果你这样定义创造力的话,那么 AI 没有创造力,AI 无法输出任何训练集中没有的东西,它最多只能把训练集中的内容进行整理拼接。

神经网络的学习目标不仅仅是“背诵”训练数据,而是学习数据背后的“规律”。

举个例子,如果 AI 只看过了猫和狗的照片,它确实画不出马。但是,如果它学习了足够多的骨骼结构、皮毛纹理和光影规律,它完全可以画出一只这世界上从未存在过的、姿态怪异的“猫”。

这种能力叫作“泛化”。AlphaGo 在围棋比赛中下出了人类几千年棋谱中从未有过的“第 37 手”,震惊了棋坛。这并不是因为它有了自我意识,而是因为它在人类教给它的规则框架内,通过计算找到了人类未曾发现的最优解。

所以,AI 确实无法凭空创造出它完全没见过的基本概念(比如没见过色彩就无法理解红色),但它绝对可以在既有概念的基础上,进行远超人类想象力的组合与推演。这在某种程度上,已经是一种基于数学规律的“创造力”。

为什么神经网络这么强大,却直到最近才功能爆发?

AI 最近爆火起来,是它在绘画,文字生成等领域都展现出了前所未有的好结果。那么为什么它之前没有,而现在突然就强大了呢?

早期神经网络主要是全链接神经网路,也就是网络中的每个神经节点都和下一层的所有神经节点相连。理论上,一层这样的神经网络就可以拟合任何函数,但在实际应用中,它始终面临着三个未能解决的问题:

- 训练效率差,尤其是大型,多层神经网络,很多情况下根本无法训练。

- 硬件不能提供足够的计算资源。要拟合复杂的问题,少量神经节点肯定是不够的,节点必然越多越好。

- 缺少训练集,标注训练集是非常贵的。

近些年,以上几个问题都得到了实质性的改进。首先是算法和网络架构的创新解决了模型训练的问题。使用一些特殊的网络结构(如卷积网络、残差网络和注意力机制等)代替全链接网络,可以提高模型的训练效率和表现。这些结构可以构建上百层甚至更深的网络结构,“深度学习”由此得名。现在,那些最为知名的大型模型都是基于“Transformer”这种链接结构构建的。

要解决更复杂的问题,必然需要更多的神经元。在硬件方面,GPU 的出现,为神经网络提供了足够的计算资源。

人为标注的训练集依然十分昂贵,但是这些年互联网的蓬勃发展使得网络上的文字和图像内容极其丰富,这些内容都可以被用来做训练。

于是乎,解决了以上几个问题的 AI 开始了新一轮的大爆发。作为相关从业人员,我希望这一次的热度可以坚持更长的时间。

核心追问:AI 会产生意识吗?

回到开头的问题。既然 AI 如此强大,随着参数继续增加,它会不会“量变引起质变”,突然涌现出自我意识?

实际上,现在讨论人工智能与意识,很容易就脱离技术问题,去争论“意识”本身。毕竟,人类连“什么是意识”都尚未达成共识。有些哲学流派(如生物自然主义)认为,意识是生物体的特有属性,与肉体不可分割。��换言之,只有碳基生命的复杂生化反应才能涌现出意识,任何硅基机器,哪怕智能再高,也只是冷冰冰的计算工具。 当然,功能主义派则持相反观点:他们认为意识本质上是一种“软件”,与硬件载体无关。只要机器的行为表现(如通过图灵测试)与人无异,就应被视为具有意识。

即便我们退一步,采用功能主义的宽容标准,目前的 AI 也远未达标。诚然,若将提问限定在特定范围(如法律条款或数学计算),AI 的表现确实超越人类——正如计算器的算力远胜心算大师。但目前最先进的大语言模型,本质上仍是在极高维度上拟合人类过往的文本概率。它们是极其优秀的“文本整理者”和“概率预测机”,能完美处理有章可循的知识,却无法在脱离训练数据的开放领域中,给出真正令人满意的、具有原创性的答案。

有人会反驳:AI 也能写诗作画,这难道不是创造力吗?其实,算法中的所谓“创新”,往往源于随机数的引入和既有素材的重新排列组合。这种基于统计学的“随机扰动”或许能产生意外之喜,但 AI 致命的短板在于:它无法理解这些内容的含义,更不具备“审美判断力”。它不知道自己生成的画作是惊世骇俗还是垃圾,最终的裁决权,依然掌握在人类手中。

更深层的差异在于物理基础。虽然人工神经网络借用了“神经元”这一名词,但它与人脑的生物神经网络完全是两码事。最基本的区别在于:人脑网络是动态重构的,神经元之间的连接时刻在建立与断裂,即“突触可塑性”;而人工神经网络在训练完成后,其结构参数通常是静态固化的。此外,我们对大脑的认知仍处于幼稚阶段。人脑的学习机制尚未完全解密,甚至有物理学家(如彭罗斯)认为,量子效应可能参与了思维活动。如果意识真的涉及��量子层面的物理规律,那么仅靠当前的经典计算机架构,恐怕永远无法模拟出灵魂的火花。

就目前AI的技术来说,AI 是绝不会产生自我意识的。目前训练 AI 的方法就是让 AI 去模拟训练集中的输入输出。我们可以脑洞一下,如果有一个 AI 模型突然就有自我意识了,训练程序让它画猫,它决定放飞自我,画了一只鸡。结果会怎样呢?结果是:因为它没有达到设计目标,这个模型被销毁了。

以目前的 AI 技术而言,AI 本质上与螺丝刀、扳手等工具没有什么区别,都是由人类设计和使用的工具:人类怎么操作它,它就怎么工作,除此之外无法做任何事情。任何人类不知道如何解决的问题,AI 也同样解决不了。如果人类没有在训练数据中隐含解决问题的逻辑或线索,目前的 AI 很难凭空顿悟出全新的数学定理。

总有人觉得 AI 参数这么多,结构这么复杂,说不定它自己突然灵光一现,就产生了自我意识呢?这个想法,就有点类似于,把组成生命的各种化学物质放到一个瓶子里,然后晃一晃瓶子,就指望里面的分子自己重新排列,构建一个生命体出来。我们有时候会有一些美好的愿望,希望自己并不了解的东西可以自发的产生魔法和奇迹。但是最终这些愿望基本都会落空。

总而言之,我对人工智能作为工具的发展速度感到惊喜,但对于它演化出类人的灵魂,我始终抱有理性的悲观。